大语言模型应用架构Large Language Model Application Architecture

概述与定义

大语言模型应用架构(Large Language Model Application Architecture)并非单一技术,而是一套面向生产环境的系统性设计范式,旨在解决将基础大语言模型(如Llama 3、Qwen、GPT-4)转化为稳定、可控、可审计、可维护的企业级应用所面临的结构性挑战。它超越了传统Web API调用的简单封装,强调编排(Orchestration)、增强(Augmentation)、约束(Constraint)与可观测性(Observability)四大支柱。其核心目标是构建具备上下文感知、工具协同、逻辑闭环与合规保障的智能应用层,使LLM从‘黑盒生成器’演进为‘可信认知引擎’。

演变历程与发展脉络

- 2022年中–2022年末:探索期。以OpenAI API发布为标志,开发者开始通过简单HTTP请求调用GPT-3.5,架构极度扁平,缺乏重试、流控、缓存等工程实践,典型代表为早期ChatGPT插件原型。

- 2023年初–2023年中:框架萌芽期。LangChain v0.1发布(2023年1月),首次系统提出Chain、Agent、Tool、Memory等抽象概念;LlamaIndex(原GPT Index)v0.8引入结构化索引与检索增强范式;微软推出Semantic Kernel,强调插件化与技能组合。

- 2023年下半年:架构分层显性化。行业共识形成“LLM应用栈”四层模型:底层模型服务(Model Serving)、中间编排层(Orchestration Layer)、上层应用逻辑(Application Logic)、边缘增强层(Augmentation Edge)。RAG成为标配架构模式,RAG与提示工程协同演进。

- 2024年至今:企业级架构成熟期。出现专用编排框架(e.g., DSPy、Flowise)、可观测性标准(LLMOps Maturity Model)、安全护栏协议(e.g., NVIDIA NeMo Guardrails)、多模态扩展支持,并与传统微服务架构深度融合,形成LLM-native Service Mesh雏形。

核心概念与原理

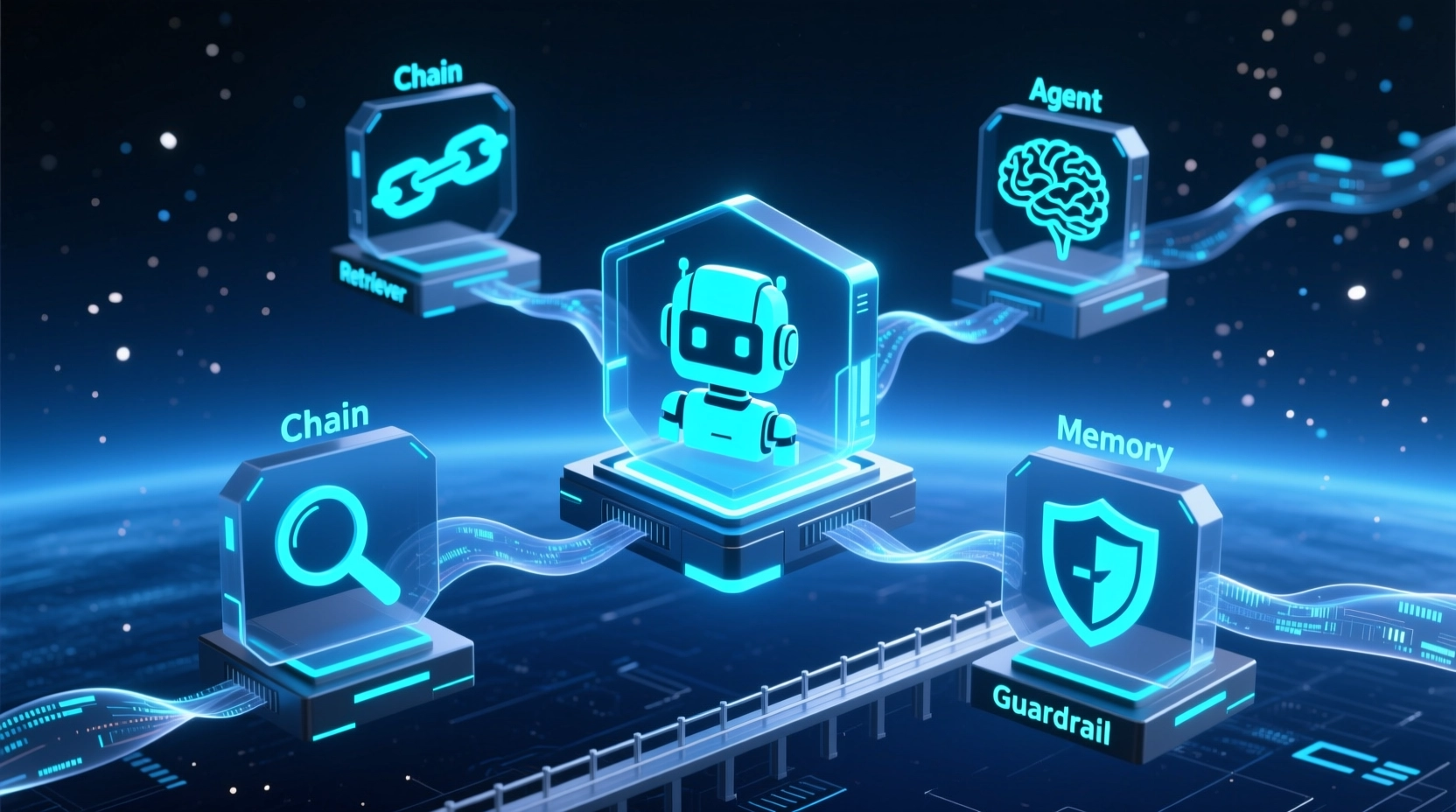

现代大语言模型应用架构建立在五大核心抽象之上:

- Chain(链):将多个LLM调用、函数执行、条件判断按序或并行组合,实现复杂任务分解与状态传递;

- Agent(代理):具备自主规划(Planning)、工具使用(Tool Use)、反思(Reflection)能力的运行时实体,是架构的智能调度中枢;

- Retriever(检索器):与向量数据库深度耦合,负责动态注入高质量上下文,缓解幻觉并提升事实一致性;

- Memory(记忆):分为短期对话记忆(ConversationBufferMemory)与长期知识记忆(Entity Memory/Summary Memory),支撑多轮上下文连贯性;

- Guardrail(护栏):包含输入过滤(Input Sanitization)、输出审核(Output Moderation)、内容脱敏(PII Redaction)、合规策略引擎(Policy Enforcement Engine)等实时安全控制单元。

技术架构

典型的生产级大语言模型应用架构可分为六层,各层职责清晰、松耦合、可独立演进:

| 层级 | 核心组件 | 关键能力 | 代表开源/商业方案 |

|---|---|---|---|

| 1. 接入层 | API网关、认证鉴权、速率限制 | 统一入口、流量治理、租户隔离 | Kong、AWS API Gateway、Azure API Management |

| 2. 编排层 | Chain调度器、Agent工作流引擎、Prompt模板中心 | 动态路由、上下文组装、失败回退、A/B测试支持 | LangChain Expression Language、DSPy Compiler、Flowise UI |

| 3. 增强层 | 检索模块、工具调用适配器、代码解释器、外部API桥接器 | 实时数据注入、多源异构工具集成、执行沙箱 | LlamaIndex Query Engine、LangChain Tools、OpenBB SDK |

| 4. 模型服务层 | 推理服务、LoRA微调加载器、量化推理引擎 | 低延迟响应、GPU资源复用、模型热切换 | vLLM、TGI(Text Generation Inference)、NVIDIA Triton |

| 5. 数据与存储层 | 向量库、图谱知识库、结构化关系库、缓存(Redis/Memcached) | 混合检索(Hybrid Search)、元数据过滤、增量索引更新 | Qdrant、Weaviate、Neo4j + LLM Embedding Plugin |

| 6. 观测与治理层 | 追踪(Tracing)、日志(Logging)、指标(Metrics)、提示版本管理、效果评估流水线 | 全链路Debug、成本归因、质量回溯、合规审计 | Langfuse、Arize Phoenix、Weights & Biases LLM Observability |

应用场景与典型案例

- 智能客服中枢:招商银行‘招小宝’采用三层RAG+Agent架构,集成内部知识库、交易日志与实时风控规则,实现7×24小时复杂业务咨询(如‘如何冻结境外盗刷卡片并申请赔付’)准确率提升至91.3%;

- 研发助手平台:华为CodeArts Snap基于自研CodeLlama微调模型,构建‘编辑器内嵌Agent’架构,支持自然语言生成单元测试、跨文件重构建议与漏洞修复,平均开发效率提升37%;

- 法律合同审查系统:金杜律师事务所联合阿里云打造‘律智通’,融合法律条文向量库、判例图谱与条款合规校验护栏,实现合同风险点自动定位与修订建议生成,人工复核耗时下降65%;

- 工业设备运维知识引擎:三一重工‘智匠大脑’接入IoT时序数据+维修手册PDF+工程师经验语料,通过多跳检索与工具调用(如调用MATLAB仿真接口验证故障假设),将平均故障诊断时间从4.2小时压缩至18分钟。

发展现状与行业生态

截至2024年中,大语言模型应用架构已形成高度活跃的开源-商业双轨生态:

- 开源主导:LangChain仍为GitHub Star数最高的LLM应用框架(超72k),但LlamaIndex在企业级检索增强场景渗透率快速上升(2024 Q1企业采用率同比+210%);

- 商业整合:Amazon Bedrock Agents、Google Vertex AI Agent Builder、Azure AI Studio均提供托管式应用架构平台,屏蔽底层复杂性;

- 垂直深化:医疗领域出现Med-PaLM Agent Framework,金融领域涌现FinBERT Orchestrator等专用架构套件;

- 标准化进程:MLCommons启动LLM Application Benchmark工作组,定义Latency-at-99、Cost-per-Query、Hallucination Rate等核心SLO指标;CNCF成立LLMOps SIG,推动架构可观测性规范落地。

挑战与风险

“架构越复杂,失控面越大。”——2024年LLMOps Summit技术白皮书

当前主要挑战包括:可观测性黑洞(LLM内部决策不可见导致调试困难)、状态爆炸问题(长程Agent执行中记忆膨胀与上下文截断冲突)、护栏逃逸风险(对抗性提示绕过安全策略)、成本不可控性(未优化的RAG检索+多次LLM调用导致Token开销激增)、架构锁定隐患(过度依赖特定框架API,迁移成本高昂)。

未来发展趋势

- 编排即代码(Orchestration-as-Code):YAML/DSL驱动的声明式工作流将成为主流,替代命令式Python编码;

- 轻量化本地Agent运行时:基于TinyGrad或MicroTVM的端侧Agent引擎兴起,支持手机/车机离线运行;

- 形式化验证介入:将Coq、TLA+等验证工具引入Agent行为建模,确保关键路径逻辑正确性;

- 多模态原生架构:文本、图像、音频、传感器信号统一表征与调度,突破纯文本应用边界;

- 联邦式LLM应用网络:跨组织共享Agent能力但不共享原始数据,依托差分隐私与安全多方计算实现协同进化。

与其他技术的对比分析

大语言模型应用架构与传统微服务架构存在本质差异:

- 状态管理:微服务强调无状态设计以利水平扩展;LLM应用架构则必须主动管理语义状态(如用户意图、对话历史、工具执行结果);

- 错误语义:微服务失败通常为‘异常抛出’或‘HTTP 5xx’;LLM失败表现为‘幻觉输出’‘逻辑断裂’‘工具调用拒绝’,需语义级重试策略;

- 性能度量:微服务关注P99延迟、吞吐量;LLM应用更关注‘有效Token利用率’‘任务完成率’‘用户满意度NPS’等业务语义指标;

- 演化方式:微服务通过API版本升级迭代;LLM应用需同步演进Prompt模板、检索策略、护栏规则、工具集等多维参数,形成‘多维版本矩阵’。

参考资料

- Chen, S. et al. (2023). LangChain: A Framework for Building Applications with LLMs. LangChain Documentation v0.1.

- Gao, L. et al. (2023). LlamaIndex: A Data Framework for LLM Applications. arXiv:2308.03689.

- Microsoft. (2023). Semantic Kernel Architecture Overview. Microsoft Docs.

- LLMOps Community. (2024). State of LLM Application Architecture 2024. LLMOps Summit Whitepaper.

- MLCommons. (2024). LLM Application Benchmark v0.5 Specification. https://mlcommons.org/llm-benchmark