微调Fine-tuning

概述与定义

微调(Fine-tuning)是深度学习中一种典型的迁移学习策略,指将一个在大规模通用语料上完成预训练的模型,通过在目标领域或任务的较小规模标注数据集上执行额外的端到端训练,使其适应新任务的过程。与从零训练(scratch training)相比,微调利用了预训练模型已习得的语言理解、视觉表征或跨模态对齐等通用能力,仅需调整少量参数即可实现高性能适配。

其核心思想在于:预训练阶段捕获的是通用表征能力(如语法结构、实体关系、图像纹理与语义层次),而微调阶段则聚焦于任务特定判别能力(如情感极性分类、医学实体识别、工业缺陷检测)。该范式已成为自然语言处理(NLP)、计算机视觉(CV)及多模态AI工程实践的标准流程。

演变历程与发展脉络

- 2017–2018年:早期探索与方法奠基 — ULMFiT(Howard & Ruder, 2018)首次系统提出三阶段微调框架(通用域微调→领域自适应微调→任务微调),引入分层学习率与渐进式解冻策略,验证了在小样本文本分类任务中的有效性。

- 2018–2019年:BERT引爆范式革命 — Devlin 等人在BERT论文中确立“预训练+微调”双阶段标准范式,以[CLS]向量直接接入分类头,在GLUE基准上全面超越传统模型,微调由此成为NLP工业界默认路径。

- 2020–2022年:规模化与效率演进 — 随着T5、GPT-3等超大规模模型出现,全参数微调显存与计算成本剧增,催生参数高效微调(PEFT)研究,包括Adapter、Prefix-Tuning、LoRA等方法,实现<1%参数更新量下的性能逼近。

- 2023–2024年:指令驱动与多阶段协同 — 指令微调(Instruction Tuning)与强化学习人类反馈(RLHF)深度融合,微调不再局限于监督数据拟合,更强调对齐人类意图;同时,微调与检索增强(RAG)、模型蒸馏形成技术栈组合,构建生产级AI系统。

核心概念与原理

微调的本质是优化目标函数的转移:预训练阶段最小化语言建模损失(如MLM、Next Token Prediction),而微调阶段则切换为任务特定损失(如交叉熵用于分类、L1损失用于回归)。其可行性建立在两大理论支撑之上:

- 表征可迁移性假设:深层神经网络前几层学习通用低级特征(边缘、词根),中间层编码中层语义(短语、物体部件),顶层适配任务逻辑;因此仅微调顶层或插入轻量模块即可完成适配。

- 梯度相似性原理:在预训练收敛区域附近,不同下游任务的损失函数梯度方向具有局部一致性,使得一次预训练可支撑多任务微调。

典型微调类型包括:全参数微调(更新全部权重)、冻结微调(仅训练新增分类头)、分层微调(底层冻结、顶层解冻)、以及参数高效微调(仅更新低秩矩阵、提示向量等新增参数)。

技术架构

现代微调技术栈已形成清晰分层架构,下表对比主流微调方法的技术特性:

| 方法 | 可训练参数占比 | 推理开销增量 | 适用场景 | 代表实现 |

|---|---|---|---|---|

| 全参数微调 | 100% | 无 | 算力充足、任务关键、数据丰富 | Hugging Face Trainer |

| Adapter | 0.5–5% | +10–15% latency | 多任务共享主干、需快速切换 | AdapterHub |

| LoRA | 0.1–1% | +1–3% latency | 大模型轻量适配、GPU资源受限 | peft + transformers |

| QLoRA | <0.1% | +5–8% latency(含量化开销) | 单卡微调70B模型、边缘部署 | bitsandbytes + peft |

| Prefix-Tuning | 0.2–2% | +5% context length | 生成式任务、避免修改原权重 | OpenPrompt |

应用场景与典型案例

- 金融风控:招商银行基于BERT微调构建财报关键信息抽取模型,准确率较规则引擎提升37%,支持年报中非结构化风险描述的自动化解析。

- 医疗影像:推想医疗采用ResNet-50在胸部X光数据集上微调,实现肺结节良恶性二分类AUC达0.94,已获NMPA三类证并部署于全国200+医院。

- 智能客服:阿里云Qwen-7B经电商对话指令微调后,在淘宝售后意图识别任务F1达0.91,响应时延低于300ms,日均服务超2亿次。

- 工业质检:宁德时代联合华为云,对ViT模型在电池极片划痕图像上微调,缺陷检出率从82%提升至99.6%,误报率下降至0.03%。

发展现状与行业生态

截至2024年,微调已从研究技术演进为标准化AI工程能力。Hugging Face Hub托管超50万个微调后模型,涵盖120+语言和50+垂直领域;参数高效微调(PEFT)成为开源社区事实标准,peft库下载量月均超200万次。云厂商加速工具链整合:AWS SageMaker JumpStart提供一键微调模板;Azure ML支持分布式LoRA训练;阿里云百炼平台集成可视化微调工作流。学术界持续拓展边界,如指令微调与大语言模型对齐研究成为NeurIPS/ICML热点议题。

挑战与风险

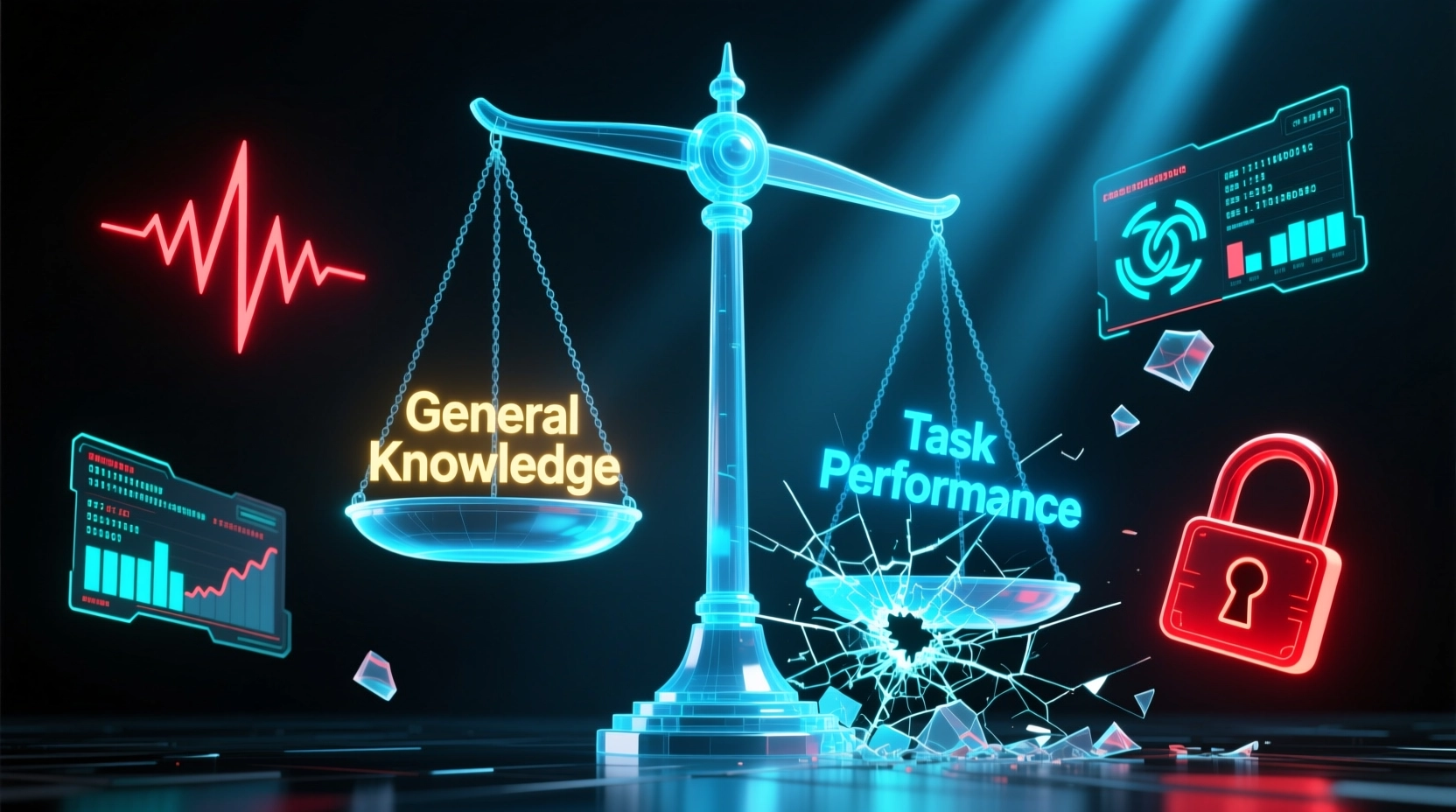

- 灾难性遗忘:微调可能导致模型丢失预训练阶段获得的通用知识,尤其在小样本或强偏差数据下;缓解方案包括弹性权重固化(EWC)与知识蒸馏回传。

- 数据质量依赖:微调性能高度敏感于标注质量,噪声标签易引发过拟合;需结合主动学习与不确定性采样优化标注效率。

- 安全对齐弱化:未经约束的微调可能削弱RLHF建立的伦理护栏,导致越狱(jailbreak)行为增加;需引入宪法式微调(Constitutional AI)机制。

- 版权与合规风险:商用微调模型若使用受版权保护的专有数据训练,可能引发法律争议;欧盟AI Act与中国《生成式AI服务管理暂行办法》均要求披露训练数据来源。

未来发展趋势

- 自动化微调(AutoFT):结合NAS(神经架构搜索)与超参优化,自动选择最优微调策略、学习率曲线与模块插入位置。

- 持续微调(Continual Fine-tuning):支持模型在流式数据上动态更新,避免重复全量训练,满足金融、舆情等实时性场景需求。

- 多模态联合微调:文本-图像-语音三模态统一表征空间下的协同微调框架(如Flamingo、KOSMOS-2),突破单模态任务边界。

- 微调即服务(FTaaS):云平台提供免代码微调管道、数据版本控制、模型效果追踪与A/B测试能力,降低AI应用门槛。

参考资料

- Devlin, J., et al. (2019). BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding. NAACL-HLT.

- Houlsby, N., et al. (2019). Parameter-Efficient Transfer Learning for NLP. ICML.

- Hu, E. J., et al. (2021). LoRA: Low-Rank Adaptation of Large Language Models. ICLR.

- Chung, H. W., et al. (2022). Scaling Instruction-Finetuned Language Models. arXiv:2210.11416.

- Microsoft. (2023). QLoRA: Efficient Finetuning of Quantized LLMs. GitHub Repository & Technical Report.

与其他技术的对比分析

微调常被混淆于以下相近概念,但存在本质差异:

微调 vs 提示工程(Prompt Engineering):前者修改模型内部参数,具备强泛化性与鲁棒性;后者仅设计输入文本模板,不改变模型权重,零样本/少样本友好但性能上限受限。

微调 vs 模型蒸馏(Knowledge Distillation):蒸馏是将大模型“知识”压缩至小模型,属模型压缩技术;微调则是同一模型在不同任务间的适配,二者可组合使用(如先蒸馏后微调)。

微调 vs 检索增强生成(RAG):RAG通过外部知识库动态注入信息,不修改模型;微调将领域知识固化于参数中。实践中常融合——用RAG缓解微调数据不足,用微调优化RAG排序器。