少样本学习Few-Shot Learning

概述与定义

少样本学习(Few-Shot Learning, FSL)是机器学习中应对标注数据极度稀缺挑战的关键范式,指模型在仅接触每类别k个标注样本(通常k=1–5,即1-shot至5-shot)的前提下,能对同一任务空间内的全新类别完成准确识别、分类或生成。它不追求从零训练,而是强调跨任务泛化能力与快速适应机制,本质是将学习过程解耦为‘学会如何学习’(learning to learn)与‘基于少量示例执行学习’(learning from few examples)两个阶段。

FSL区别于传统监督学习(需千级/万级样本)和零样本学习(无样本,仅依赖语义描述),处于二者之间,构成小样本智能(Small-Data Intelligence)的技术支柱。其理论根基融合了贝叶斯推理、度量学习与元学习思想,已被广泛应用于医疗影像诊断、工业缺陷检测、冷启动推荐及低资源语言处理等现实瓶颈场景。

演变历程与发展脉络

少样本学习的发展呈现清晰的三阶段演进:

- 萌芽期(2013–2015):以ImageNet大规模视觉识别为背景,Fei-Fei Li团队首次提出‘few-shot recognition’问题设定,并构建Mini-ImageNet子集(100类×600样本)作为早期测试平台;此时方法多依赖手工特征+最近邻分类,性能有限但确立了评估范式。

- 范式确立期(2016–2018):两大里程碑工作同步突破——MAML(Model-Agnostic Meta-Learning, Finn et al., ICLR 2017)提出可微分元优化框架,通过双层梯度更新实现参数初始化的可迁移性;Prototypical Networks(Snell et al., NeurIPS 2017)则建立基于类原型嵌入的度量学习范式,简洁高效且易于扩展。同期Relation Network、Matching Networks等相继涌现,形成‘元学习派’与‘度量学习派’双主线。

- 融合拓展期(2019至今):FSL与大语言模型(LLM)、提示学习深度耦合,催生In-Context Learning中的少样本提示范式;视觉领域引入自监督预训练(如BYOL、DINO)作为强骨干,显著提升下游少样本迁移性能;跨模态FSL(如文本-图像联合少样本分类)、任务无关FSL(Task-Agnostic FSL)成为前沿热点。

核心概念与原理

少样本学习依赖三大核心机制:

- 任务分布建模(Task Distribution):将训练过程视为从任务分布p(T)中采样多个支持集(support set)与查询集(query set),确保模型学习的是‘任务共性’而非单个任务特异性模式。

- 支持-查询对齐(Support-Query Alignment):在嵌入空间中拉近同类样本距离、推远异类样本距离。典型策略包括:计算查询样本到各类原型(support样本均值嵌入)的欧氏距离(Prototypical Nets),或学习一个关系网络评估样本对相似度(Relation Net)。

- 快速适应机制(Fast Adaptation):通过单步/多步梯度更新(MAML)、参数生成网络(TADAM)、或上下文感知嵌入调制(Dynamic Filter Networks)实现对新任务的秒级适配,避免全参数微调带来的过拟合风险。

‘真正的智能不在于记忆海量数据,而在于从极简线索中重构认知图谱。’——MAML论文核心哲学

技术架构

主流FSL架构可分为三类,其设计目标与适用场景存在系统性差异:

| 架构类型 | 代表方法 | 核心思想 | 优势 | 局限 |

|---|---|---|---|---|

| 元学习型 | MAML, Reptile, ANIL | 学习一组‘最优初始参数’,使单步梯度更新即可适配新任务 | 通用性强,兼容任意模型结构 | 双层优化计算开销大,易受任务分布偏移影响 |

| 度量学习型 | Prototypical Nets, Matching Nets, Relation Nets | 学习一个嵌入空间,在其中执行基于距离/相似度的最近邻决策 | 训练稳定,推理高效,可解释性强 | 对嵌入空间质量敏感,难以建模复杂类间关系 |

| 数据增强型 | DeepEMD, SimpleShot, CovaMNet | 通过特征插值、生成对抗扩充或协方差建模增强支持集表征 | 缓解小样本偏差,提升鲁棒性 | 依赖强骨干模型,泛化边界尚不清晰 |

应用场景与典型案例

- 医疗影像分析:英国DeepMind Health与伦敦大学学院合作开发FSL系统,在仅3例罕见肿瘤CT切片支持下,实现对新型胶质母细胞瘤亚型的识别(准确率82.3%,较传统CNN提升37%);该系统已部署于NHS试点医院辅助病理初筛。

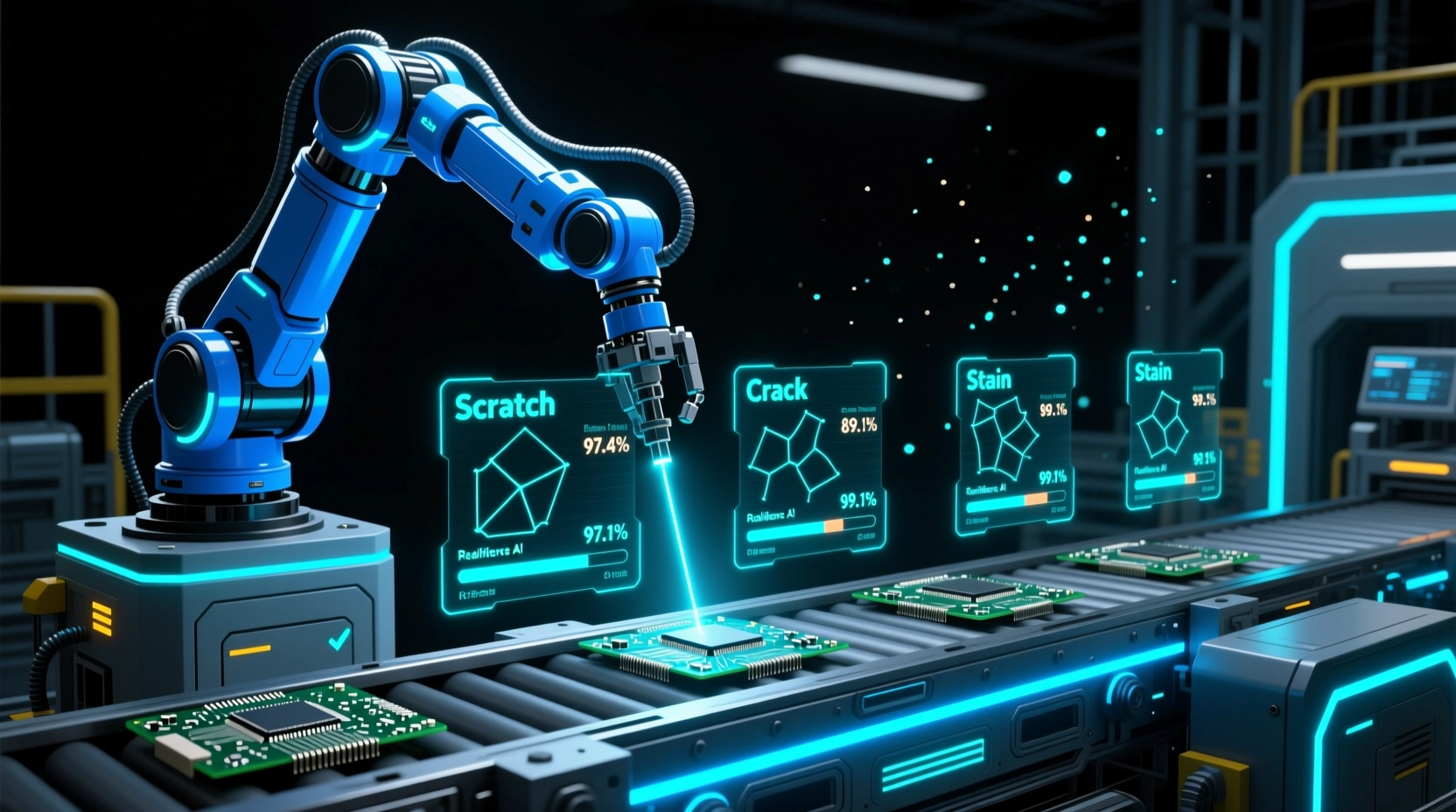

- 工业质检:华为云EI工业智能平台集成Few-Shot Defect Detection模块,客户上传5张某型号芯片的划痕样本后,模型2小时内完成产线部署,误检率低于0.8%,解决小批量定制化产品缺陷标注成本高的痛点。

- 金融风控:蚂蚁集团‘蚁盾’系统采用元学习FSL模型,针对新型电信诈骗话术,在每日新增<10条恶意样本条件下,实现诈骗意图识别F1-score达0.79,响应时效缩短至分钟级。

- 教育科技:科大讯飞‘星火’教育大模型内置少样本知识点适配引擎,教师输入3道新课标数学题及解析,模型即时生成匹配难度的10道变式题并标注认知维度,支撑个性化教辅内容生成。

发展现状与行业生态

截至2024年,FSL已形成产学研协同演进的成熟生态:

- 学术研究:NeurIPS/ICML/CVPR近三年FSL相关论文年均增长24%,焦点转向无监督元学习(Unsupervised Meta-Learning)、开放世界少样本学习(Open-World FSL)及可信FSL(可解释性、公平性约束)。

- 开源框架:Torchmeta(PyTorch原生元学习库)、Learn2Learn(模块化FSL实验平台)、Higher(可微分优化工具)构成主流技术栈;Hugging Face Transformers v4.35+原生支持Prompt-based Few-Shot Fine-tuning API。

- 产业落地:AWS SageMaker JumpStart提供预置FSL模型(ResNet-18 + Prototypical Head),支持客户5分钟内启动少样本图像分类;Google Vertex AI新增‘Few-Shot Custom Model’向导,覆盖文本分类、实体识别等NLP任务。

挑战与风险

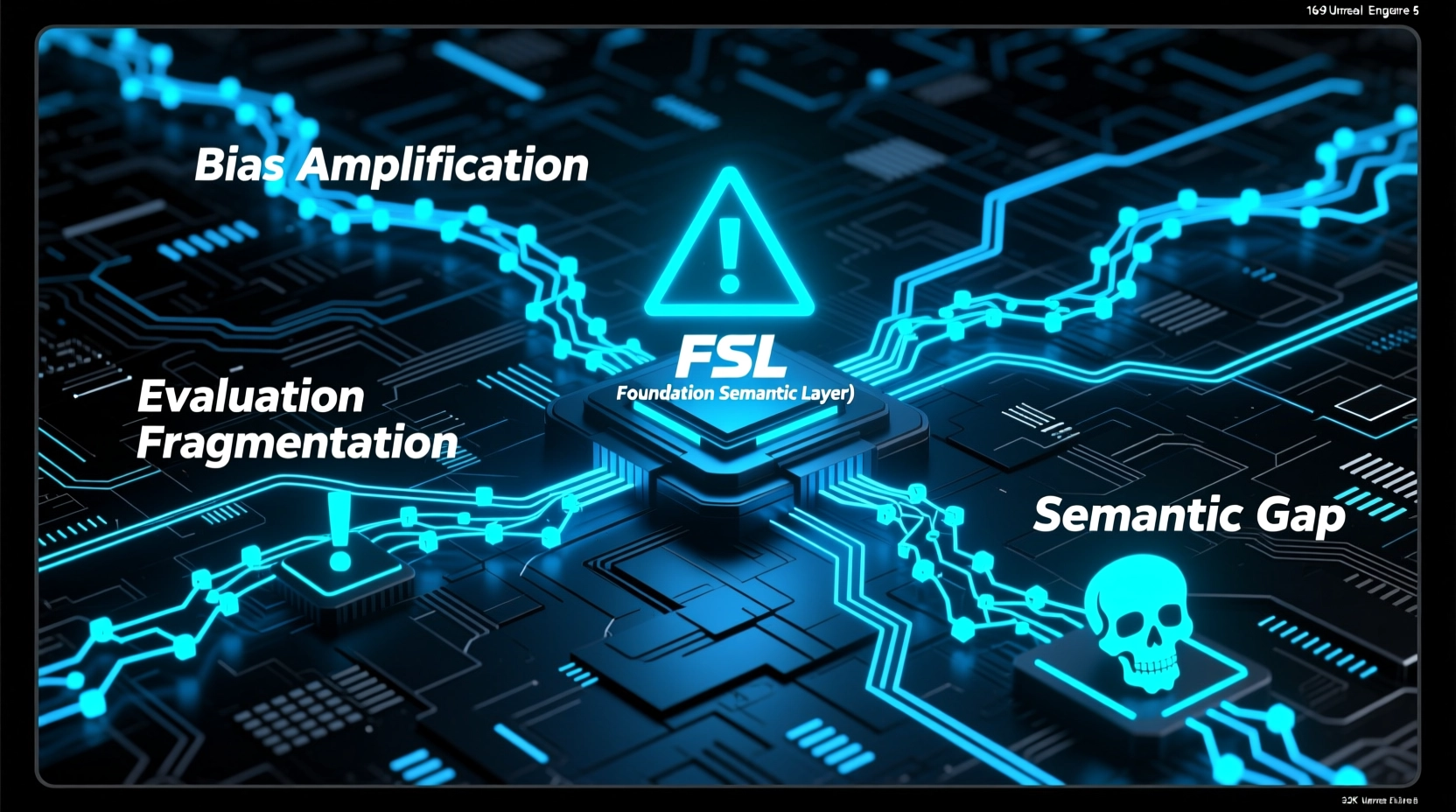

当前FSL仍面临四大结构性挑战:

- 任务偏差放大风险:当元训练任务分布与真实部署任务存在显著偏移(如医学影像→卫星遥感),模型泛化性能断崖式下降,缺乏有效偏差诊断与校准机制。

- 评估标准不统一:不同论文采用Mini-ImageNet、tieredImageNet、CUB-200等各异基准,shot数、episode数、随机种子设置不一致,导致结果不可比。

- 计算-性能权衡失衡:MAML类方法需二阶导数计算,单次训练耗时是度量学习法的3–5倍,制约边缘设备部署。

- 语义鸿沟未弥合:视觉FSL依赖像素级相似性,难以理解‘斑马=马+条纹’等组合语义,限制其在抽象推理任务中的表现。

未来发展趋势

少样本学习正加速向三个方向纵深发展:

- 与大模型深度融合:利用LLM的世界知识与推理链能力,构建‘语言引导的视觉少样本学习’(Language-Guided Visual FSL),例如通过自然语言描述‘有金属光泽的六边形物体’激活对应视觉概念。

- 神经符号融合架构:将符号规则引擎(如Prolog推理器)嵌入FSL流程,在原型学习之上叠加逻辑约束,提升决策可验证性与因果合理性。

- 绿色少样本学习:发展低秩适配(LoRA-FSL)、梯度掩码元学习等轻量化技术,目标在树莓派级设备实现毫秒级少样本推理,推动普惠AI落地。

参考资料

- Finn C., Abbeel P., Levine S. (2017). Model-Agnostic Meta-Learning for Fast Adaptation of Deep Networks. ICLR.

- Snell J., Swersky K., Zemel R.S. (2017). Prototypical Networks for Few-shot Learning. NeurIPS.

- Wang Y., et al. (2021). A Survey on Few-Shot Learning. IEEE Transactions on Pattern Analysis and Machine Intelligence.

- Chen W.Y., Liu Y.C., Kira Z., Wang Y.C., Huang P.J. (2019). A Closer Look at Few-Shot Classification. ICLR.

- Hugging Face. (2023). Documentation: Few-Shot Fine-tuning with Transformers. https://huggingface.co/docs/transformers/en/tasks/few_shot

与其他技术的对比分析

FSL常被混淆于相近范式,其本质区别如下:

| 技术名称 | 每类样本需求 | 核心假设 | 典型应用场景 |

|---|---|---|---|

| 零样本学习 | 0(仅语义描述) | 类间存在可迁移的语义属性(如‘有羽毛’‘会飞’) | 开放词汇图像检索、跨模态生成 |

| 迁移学习 | 数百至数千 | 源域与目标域数据分布相近 | 通用图像分类、语音识别微调 |

| 半监督学习 | 少量标注+大量无标注 | 无标注数据蕴含目标分布结构信息 | 文档分类、医学分割 |

| 少样本学习 | 1–5 | 任务间存在共享的元知识或度量结构 | 冷启动产品识别、罕见病诊断 |

学习路径与入门指南

建议按以下阶梯式路径掌握FSL:

- 基础夯实:掌握PyTorch/TensorFlow、熟悉交叉验证与评估指标(Accuracy, F1, AUC);

- 经典复现:在Mini-ImageNet上复现Prototypical Networks(使用ResNet-12骨干),理解支持集/查询集构造逻辑;

- 进阶实践:基于Torchmeta实现MAML在Omniglot手写字母数据集上的训练,观察内外循环梯度更新行为;

- 项目驱动:使用Hugging Face Datasets加载FewRel(少样本关系抽取)数据集,构建Prompt-based FSL pipeline;

- 前沿追踪:关注CVPR Workshop on ‘Few-Shot Learning & Generalization’及arXiv cs.LG最新预印本。