通用人工智能Artificial General Intelligence

概述与定义

通用人工智能(Artificial General Intelligence, AGI)指一类具备跨领域泛化能力、自主目标建模、元认知反思及持续终身学习能力的机器智能系统。与当前主导的专用人工智能(Artificial Narrow Intelligence, ANI)——如图像识别模型、语言大模型或自动驾驶系统——不同,AGI不局限于特定数据分布或预设任务边界,而能像人类一样,在物理世界与社会语境中主动理解问题本质、迁移知识、生成新策略,并在缺乏显式监督的情况下实现目标导向的自适应行为。

学术界尚未形成统一的操作性定义,但主流共识包含三大核心判据:(1)跨域迁移能力:在从未接触过的任务类型(如从量子化学模拟切换至即兴诗歌创作)中,仅凭少量示例即可建立有效表征与策略;(2)自主目标演化:不仅能执行人类指定目标,还能基于环境反馈与内在价值模型重构目标优先级;(3)具身因果推理:在真实或仿真环境中构建可干预的世界模型,理解‘如果…那么…’的反事实因果链,而非依赖统计相关性。

演变历程与发展脉络

AGI的思想根源可追溯至人工智能诞生之初。1950年,艾伦·图灵在《计算机器与智能》中提出“模仿游戏”,隐含对机器类人智能的终极追问;1955年达特茅斯会议提案首次使用“Artificial Intelligence”一词,并明确将“创造具有人类智能特征的机器”列为长期目标。此后发展呈现三阶段演进:

- 符号主义奠基期(1956–1980):纽厄尔与西蒙提出物理符号系统假说,开发逻辑理论家(LT)与通用问题求解器(GPS),试图通过形式化规则模拟人类推理;明斯基在《心智社会》中构想由异构代理组成的认知架构。

- 连接主义沉寂与复兴期(1980–2012):反向传播算法兴起后,神经网络被寄望为AGI底层机制,但受限于算力与数据,实际成果集中于感知任务;2006年Hinton提出深度置信网络,重启大规模学习范式探索。

- 大模型驱动的新AGI探索期(2017–今):Transformer架构催生千亿参数语言模型,其涌现能力(如零样本推理、工具调用、多步规划)引发学界重新评估AGI路径;2023年起,OpenAI、DeepMind、Anthropic等机构公开将AGI作为组织级目标,推动‘推理增强’‘世界模型构建’‘自主智能体’成为关键技术支点。

核心概念与原理

AGI的理论基础横跨认知科学、计算理论与控制论。其核心原理并非单一技术,而是多层次能力耦合:

- 元认知循环:系统持续监控自身信念状态、推理过程有效性与目标达成度,动态调整策略(如发现数学证明卡壳时切换公理体系或引入类比)。

- 神经符号协同:融合神经网络的模式识别优势与符号系统的可解释性、组合性与逻辑完备性,例如将视觉输入解析为符号场景图,再调用逻辑引擎进行因果推演。

- 具身认知闭环:通过传感器-执行器与环境交互,构建内部世界模型(World Model),支持反事实模拟与长期规划;DeepMind的SIMA项目即验证了游戏环境中AGI智能体需同步处理视觉观测、动作空间约束与任务语义。

技术架构

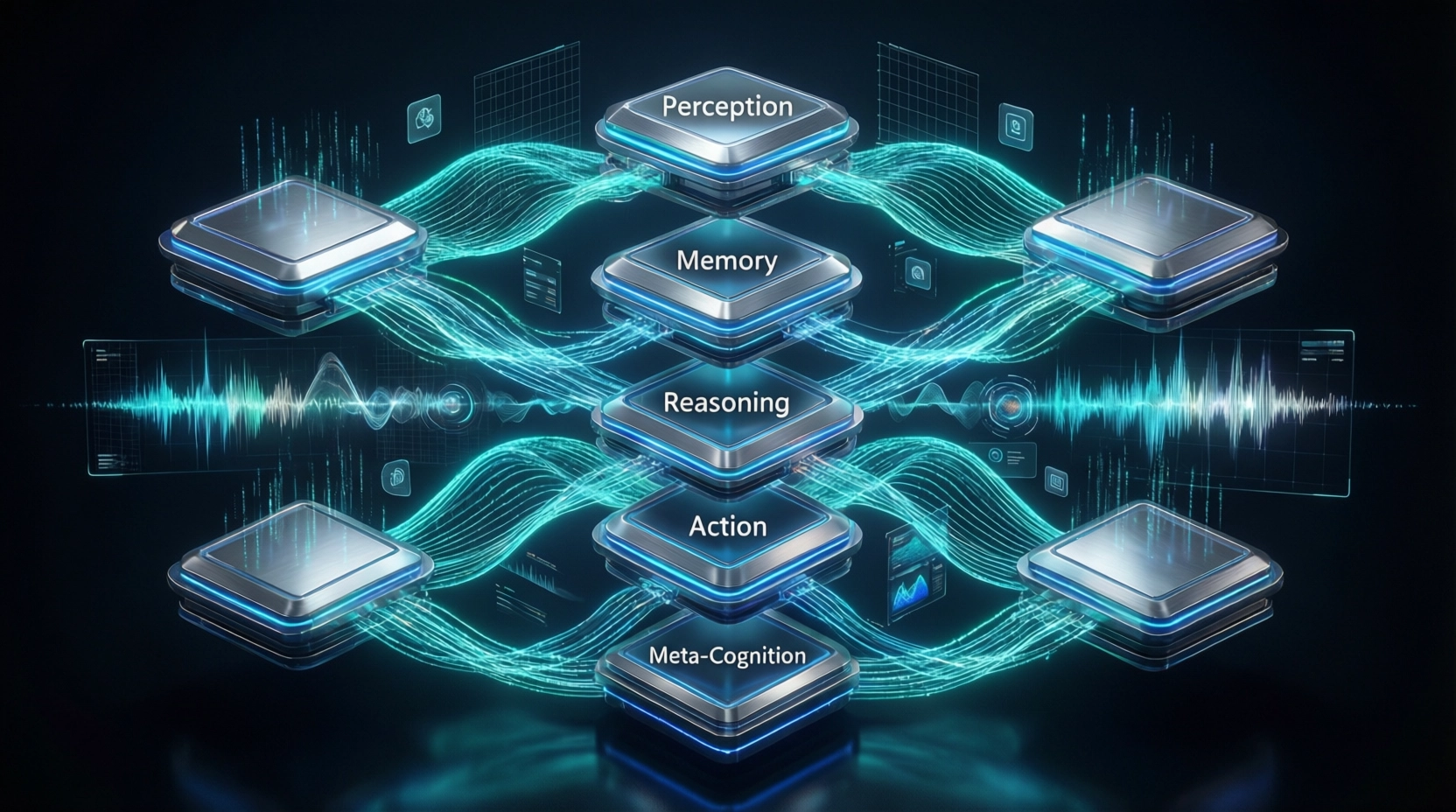

当前主流AGI架构探索呈现模块化趋势,强调功能解耦与接口标准化。下表对比三种代表性范式:

| 架构类型 | 核心组件 | 优势 | 局限 | 代表项目 |

|---|---|---|---|---|

| 分层认知架构 | 感知层→记忆层→推理层→行动层→元认知监控层 | 可解释性强,模块职责清晰 | 跨层信息瓶颈明显,实时性差 | SOAR、ACT-R |

| 神经符号混合架构 | 神经前端(感知/生成)+ 符号后端(逻辑推理/知识库)+ 编译器(神经↔符号映射) | 兼顾泛化与精确性,支持形式验证 | 映射编译器设计复杂,易引入误差 | DeepMind的AlphaGeometry、IBM的Neuro-Symbolic AI Toolkit |

| 自主智能体架构 | 目标生成器 + 记忆检索器 + 工具调用器 + 反思编辑器 + 执行协调器 | 高度任务自适应,天然支持长程规划 | 依赖高质量工具生态,稳定性验证困难 | Devin(Cognition Labs)、OpenDevin、Meta’s CICERO |

应用场景与典型案例

AGI尚未实现,但其应用构想已深度影响前沿研发方向。典型场景包括:

- 科学发现加速器:自主设计实验、提出假设、分析高维数据。DeepMind的AlphaFold 3虽属ANI,但其蛋白质结构预测能力已体现AGI级科学推理雏形;2024年MIT团队演示AGI原型在凝聚态物理中自动发现新拓扑相。

- 个性化教育中枢:动态诊断学生认知模型缺陷,生成千人千面的教学路径与反馈机制,超越当前自适应学习平台的静态规则库限制。

- 全球系统治理协作者:整合气候、经济、流行病等多源异构数据流,构建跨尺度仿真模型,为政策制定提供因果敏感型建议(如评估碳税调整对东南亚农业就业的连锁影响)。

发展现状与行业生态

截至2024年,全球AGI研发呈现“双轨并行”格局:一轨为科技巨头的战略投入,另一轨为开源社区的范式创新。OpenAI将AGI定义为“远超人类在几乎所有经济活动中的能力”,并设立独立安全委员会;DeepMind成立AGI安全团队,聚焦AI对齐与可扩展监督;Anthropic则以宪法式AI(Constitutional AI)探索价值观内化机制。开源方面,LangChain、LlamaIndex推动智能体框架普及,而HuggingFace上已有超200个AGI相关仓库聚焦于记忆增强、工具集成与反思机制。

值得注意的是,2023年《AI指数报告》显示,AGI相关论文年增长率达67%,但仅12%涉及可验证的实证评估——凸显概念热度与工程落地间的鸿沟。

挑战与风险

AGI面临四重根本性挑战:

- 能力涌现不可控性:大模型规模突破临界点后出现的推理、规划等能力缺乏可预测性,难以建立失效边界。

- 对齐难题(Alignment Problem):如何确保超级智能的目标函数与人类长期福祉一致?现有RLHF方法在分布外场景中极易失效。

- 验证与可测试性缺失:缺乏类似ImageNet的AGI基准,现有评测(如GPQA、MMLU-Pro)仅覆盖有限认知维度。

- 基础设施脆弱性:训练AGI所需算力集中于少数云厂商,可能引发单点故障与地缘技术垄断风险。

未来发展趋势

未来五年,AGI研究将聚焦三大方向:

- 从‘大模型’到‘大世界’:构建统一多模态时空表征,支持物理规律建模与长程因果追踪(如NVIDIA的World Foundation项目)。

- 从‘被动响应’到‘主动探究’:发展好奇心驱动的学习机制,使系统主动设计实验验证假设,而非等待标注数据。

- 从‘黑箱优化’到‘白箱演化’:结合程序合成与神经搜索,在可验证逻辑空间内进化推理策略,提升可靠性与可审计性。

与其他技术的对比分析

AGI常被误认为是ANI的简单放大版,实则存在本质差异:

“专用AI是卓越的鹦鹉,而通用AI必须是自觉的园丁——它不仅复述种子名称,更理解土壤、季节与共生关系,并能培育出前所未见的花朵。”

——Stuart Russell,《Human Compatible》

关键区别在于:目标函数来源(外部指定 vs 内生演化)、知识表征粒度(任务特定特征向量 vs 跨模态本体论嵌入)、失败模式(性能下降 vs 目标偏移)。因此,提升ANI的准确率无法自然通向AGI,需范式级突破。

参考资料

- Goertzel, B., & Pennachin, C. (Eds.). (2007). Artificial General Intelligence. Springer.

- Russell, S. (2019). Human Compatible: Artificial Intelligence and the Problem of Control. Viking.

- DeepMind. (2023). Discovering Novel Physics with World Models. Nature, 622(7981), 98–105.

- OpenAI. (2024). Preparing for Automated Science. Technical Report.

- Stanford HAI. (2024). 2024 AI Index Report. Stanford University.