产品介绍

产品概述

C-Eval 排行榜是一个用于评估和展示不同大语言模型(LLMs)在多层次、多学科中文任务中综合能力的公开榜单。其核心价值在于为研究者和开发者提供一个标准化的中文能力评测基准,以客观、量化地比较不同模型的性能。该排行榜已于2025年7月26日停止维护并公开测试集,未来将从官网移除。

发展历史

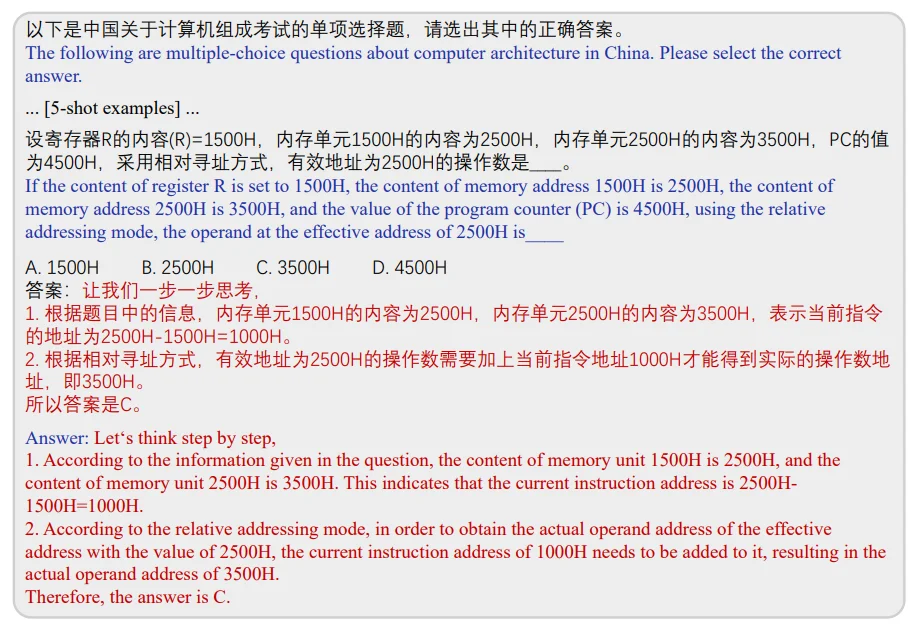

根据官网信息,C-Eval 发布于2023年。重要里程碑包括:2023年6月8日对排行榜进行更新,采用 Few-shot 和 Zero-shot 中表现最优的结果;2025年7月26日,团队宣布停止维护排行榜,并将测试集在 Huggingface 上公开,未来会从网站移除该榜单。暂无具体的融资历史信息。

产品功能

1. 模型分类展示:将模型分为“公开访问的模型”和“限制访问的模型”两类进行排名。 2. 多维度能力评估:提供模型在平均、平均(Hard)、STEM、社会科学、人文科学、其他等多个维度的测试分数。 3. 结果来源标注:通过星号(*)标注由 C-Eval 团队测试的结果,以区分用户提交的结果。 4. 模型详情查看:可点击模型名称查看其具体描述和使用的提示词(prompt)形式。

技术优势

暂无相关信息。提供的材料主要描述了榜单的展示方式和更新历史,未提及与其他评测基准相比的具体技术优势。

典型应用场景

1. 模型能力横向对比:研究机构或开发者可以快速比较不同大语言模型在中文知识、推理等任务上的综合表现。 2. 模型选型参考:企业在选择适合自身业务的大语言模型时,可参考该榜单作为中文能力评估的依据之一。 3. 学术研究基准:研究人员可使用已公开的 C-Eval 测试集,在自己的实验环境中复现或验证模型的性能。