产品介绍

所属公司

BerriAI

产品概述

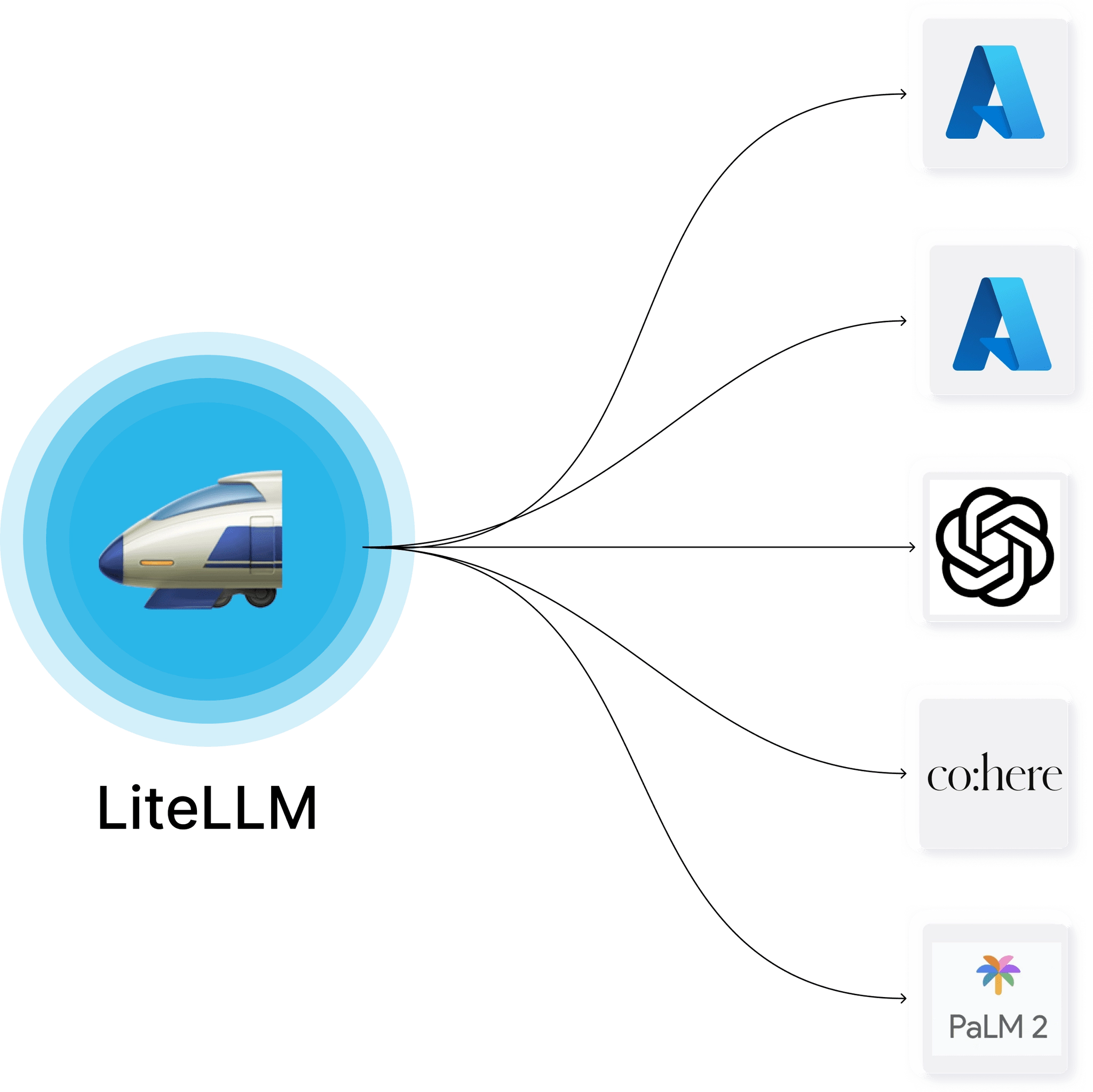

LiteLLM 是一个开源的 LLM(大型语言模型)网关工具和 Python SDK。它提供了一个统一的接口,允许开发者通过 OpenAI 兼容的格式调用 100 多个不同供应商的 LLM API。其核心价值在于简化了多模型 API 的集成与管理,并内置了成本追踪、负载均衡、护栏和日志记录等企业级功能。

发展历史

暂无相关信息。根据公开的 PyPI 记录,其首个版本于 2023年7月27日 发布。

产品功能

统一 API 接口:通过 OpenAI 或原生格式,调用超过 100 种不同的 LLM API(如 Bedrock, Azure, OpenAI, VertexAI, Cohere 等)。 成本追踪:实时监控和分析不同模型 API 调用的成本消耗。 负载均衡与故障转移:在多个模型或供应商之间智能分配请求,并在一个服务失败时自动切换到备用方案。 护栏与日志记录:提供安全护栏以防止滥用,并记录所有 API 调用以便于审计和调试。 灵活的部署方式:支持通过 Python SDK 直接调用,或部署为独立的代理服务器(支持 Docker 容器化部署)。

技术优势

其独特的技术优势在于将不同供应商的 LLM API 异常统一映射为 OpenAI 的异常类型。这意味着开发者只需编写一套针对 OpenAI 的错误处理逻辑,即可无缝处理所有支持的供应商的异常,极大地简化了错误处理流程并提升了开发效率。

典型应用场景

多模型应用开发:开发者希望构建一个应用,能够灵活切换或同时使用 OpenAI GPT、Anthropic Claude、Google Gemini 等多种模型。 成本优化与监控:企业需要集中追踪和管理来自不同团队、不同模型的 AI API 调用成本。 提升服务可靠性:通过负载均衡和故障转移机制,确保在某个模型服务出现故障或限流时,应用能自动切换到其他可用模型,保障服务高可用。 简化集成流程:希望用一套熟悉的 OpenAI 格式的代码,快速接入并测试来自不同供应商的最新模型,无需为每个供应商重写适配代码。